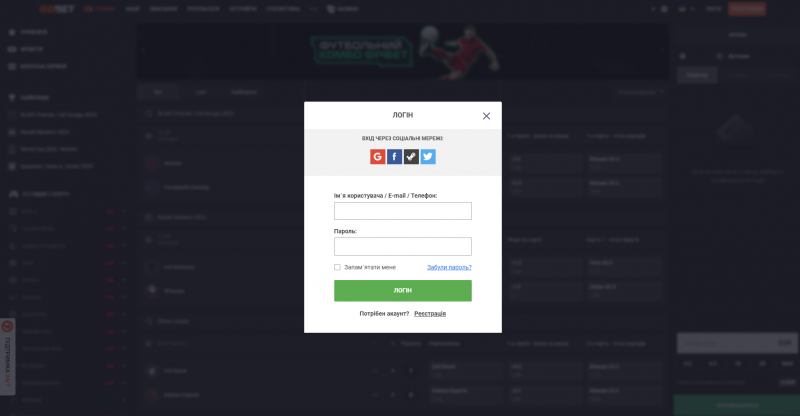

После прохождения регистрации на сайте GG.BET, возникнет необходимость войти в личный кабинет. Справиться с этой задачей не составит никакого труда. Для этого потребуется нажать в верхней части сайта вход GG.BET и в открывшемся окно ввести необходимые данные.

В момент входа вводятся логин и пароль. В качестве логина можно использовать один из предложенных на сайте вариантов. Каждый выбирает тот формат, который кажется ему наиболее удобным и выгодным. Во время входа можно будет поставить галочку Запомнить информацию и дальше во время входа форма будет заполняться автоматически. То есть, не придется вводить информацию и тратить на это время.

| 🃏 Ставки на спорт | Лицензия |

| 🃏 Адреса сайтов |

|

| 🃏 Преимущества |

|

| 🃏 Способы пополнения |

|

| 🃏 Регионы |

|

| 🃏 Какие есть бонусы |

|

| 🃏 Бонус-приветствие |

GG.BET: вход в Украине

В современном мире онлайн игры все больше набирают популярность как развлекательные платформы. GG.BET - один из таких брендов, который предлагает интересные игры и возможность выиграть большие суммы денег. Если вы находитесь в Украине и хотите войти в свой аккаунт на сайте GG.BET, следуйте простым инструкциям, чтобы получить доступ к своему игровому профилю.

Первым делом нужно зайти на официальный сайт GG.BET. Для этого воспользуйтесь вашим любимым веб-браузером и введите в адресной строке URL-адрес GG.BET. После того, как сайт загрузится, вы увидите домашнюю страницу казино, где представлены различные игры и акции.

На главной странице вы обнаружите кнопку "Вход" или "Логин". Нажмите на нее, чтобы перейти на страницу авторизации. Здесь вам потребуется ввести свои учетные данные, такие как имя пользователя и пароль, которые вы указывали при регистрации на GG.BET. Обязательно проверьте правильность введенных данных, чтобы избежать ошибок.

Если вы забыли свой пароль, не волнуйтесь. На странице авторизации вы найдете ссылку "Забыли пароль?" или что-то подобное. Щелкните по ней, чтобы восстановить доступ к вашему аккаунту. Вам может потребоваться ответить на контрольные вопросы или предоставить дополнительную информацию для подтверждения вашей личности.

После успешной авторизации вы попадете на страницу своего аккаунта на сайте GG.BET. Здесь вы сможете увидеть свой баланс, историю игр, доступные акции и многое другое. Вы также сможете выбирать и запускать любимые игры, делать ставки и участвовать в различных турнирах.

Важно помнить о безопасности вашего аккаунта. Никогда не передавайте свои учетные данные или пароль третьим лицам. Если у вас возникли подозрения в отношении безопасности вашего аккаунта, свяжитесь с службой поддержки GG.BET для получения помощи и рекомендаций.

Удачи в играх с GG.BET!

GG.BET вход в старую версию

Опытные игроки, наверняка замечали, что чем больше проходит времени с момента появления конкретного бренда онлайн казино, тем большую модернизацию он проходит. Разработчики постоянно внедряют новые функции, но это может не понравится определенным пользователям. Возникает интерес к возможности осуществить вход в старую версию GG.BET. Для этого существует множество причин и главные из них стоит разобрать подробнее.

Старая версия GG.BET может подарить пользователю несколько существенных преимуществ, ради которых её поискам и стоит уделить некоторое количество времени:

- Ностальгия и эмоциональная привязанность. Каждому участнику в определенной мере желалось вернуться в прошлое, чтобы хотя бы на мгновение пережить те незабываемые моменты первых побед.

- Хорошо известная механика игры. Некоторые игроки не воспринимают новый интерфейс, который может быть присущ обновленным версиям онлайн казино. Чтобы справиться с подобными проблемами, настоятельно рекомендуется воспользоваться старой версией GG.BET, которая будет иметь ровно тот набор слотов и интерфейс, запомнившийся большинству опытных пользователей.

- Отсутствие ограничений. Очень часто, потребность в старой версии GG.BET возникает из-за необходимости обойти действующие ограничения на конкретный домен. Например, если перейти на сайт бренда нужно с планшета, то зачастую можно найти софт, который бы позволял без каких-либо ограничений получить доступ к любимому сайту. Даже VPN скачивать не придется.

Исходя из этих особенностей, можно сказать, что у старой версии сайта достаточно преимуществ для того, чтобы потратить лишнюю минуту на поиск доступа именно к такому варианту GG.BET.

GG.BET: вход в игровые автоматы

На веб-странице букмекерской конторы GG.BET можно получить доступ к полному ассортименту игровых автоматов. Здесь предлагаются различные слоты, которые обеспечивают захватывающее времяпрепровождение и шанс выиграть настоящие деньги.

Автоматы компании

Эти автоматы предлагают различные тематики, такие как:

- фрукты,

- приключения,

- египетские мотивы и другие

Разработчики делают все, чтобы удовлетворить разные предпочтения игроков. Их приложения обладают яркой графикой, звуковыми эффектами и захватывающей анимацией, чтобы создать атмосферу азарта и веселья.

Выигрыш с GG.BET

Автоматы букмекеров обычно имеют несколько барабанов с символами, и ваша задача - собрать выигрышную комбинацию символов на активных линиях. Они также могут предлагать различные бонусные функции:

- бесплатные вращения,

- дикие символы,

- множители выигрышей и другие, которые помогут увеличить ваши шансы на выигрыш.

Система предоставляет разнообразные варианты ставок, чтобы каждый игрок мог выбрать оптимальный размер ставки в соответствии с их предпочтениями и финансовыми возможностями. Кроме того, вы можете насладиться игрой на игровых автоматах как на реальные деньги, так и в режиме бесплатной игры, чтобы попрактиковаться или просто получить удовольствие от игрового процесса без риска потерять деньги.

Важно! Для игры на реальные деньги нужно будет пройти процедуру верификации и подтвердить свою личность и право на банковский счет, введенный в данных пользователя на сайте через личный кабинет. Это нужно, чтоб избежать мошенничества и доказать, что человек достиг совершеннолетия.

Букмекерские автоматы представляют собой отличное дополнение к спортивным ставкам и позволяют вам насладиться разнообразием игр в одном месте. Они предоставляют шанс на большие выигрыши и приятное времяпровождение для всех любителей азартных игр.

Вход в БК GG.BET

Букмекерские конторы – достойные соперники онлайн-казино. И те, и другие предлагают отличные условия для головокружительного досуга и получения прибыли. Но почему некоторые игроки игнорируют казино, проходят регистрацию и выбирают бк GG.BET? Что привлекает в подобных заведениях? В них нет красочных аппаратов и уютных столов для горячих баталий. Тут не звучат призывные мелодии и не мигают яркие огоньки. Поверьте: эти атрибуты не нужны. Ведь беттинг – царство спортивного азарта.

Для тех, кто разбираетесь в спорте

Считаете себя экспертом в баскетболе? Отлично ориентируетесь в футбольных и теннисных лигах? А, может быть, вы специалист в регби, боксе или волейболе? Проверьте свои знания и интуицию, посетив надежного букмекера. Где его найти? Список проверенных контор содержится в нашей рубрике. Можно, конечно, попытаться самостоятельно найти достойный ресурс. Но это – потеря времени, риск разочарования и неоправданных расходов денежных средств. Не стоит обрекать себя на изнурительные и не всегда результативные скитания по сети.

Ознакомившись с демо-игрой в БК, вы избавите себя от всех неприятных моментов, связанных с поиском "честных" сайтов. Вам познакомят с лучшими представителями современной азартной индустрии. Читайте обзоры матчей, выбирайте подходящий вариант, делайте "правильные" ставки на спорт и наслаждайтесь пьянящей радостью побед!

GG.BET - аккаунт

Добро пожаловать в казино GG.BET - ваш источник незабываемого азартного развлечения. Мы предоставляем огромный выбор игр и возможность играть на самых выгодных условиях. Чтобы начать свое игровое путешествие, вам потребуется войти в свой аккаунт, и сегодня мы расскажем вам, как это сделать.

1. Откройте официальный сайт казино GG.BET:

В первую очередь, вам необходимо открыть веб-сайт казино GG.BET в вашем интернет-браузере. Вы можете воспользоваться поисковой системой или ввести URL-адрес вручную. Наш сайт всегда доступен и гарантирует безопасное и защищенное игровое окружение.

2. Нажмите на кнопку "Вход" или "Авторизация":

После посещения сайта, обратите внимание на кнопку "Вход" или "Авторизация". Обычно она находится в верхней правой части или в центре сайта. Кликните на данную кнопку, чтобы перейти на страницу авторизации.

3. Предоставьте данные для входа:

На странице входа вам потребуется указать свои учетные данные - электронную почту и пароль, которые вы использовали при регистрации. Убедитесь, что вводите правильные данные, чтобы успешно войти в свой профиль. Если вы забыли пароль, воспользуйтесь опцией восстановления пароля, которая обычно доступна на этой же странице.

Поздравляем! Вы успешно вошли в свой аккаунт на сайте казино GG.BET. Теперь у вас есть полный доступ ко всем играм, акциям, бонусам и возможностям, которые мы предлагаем.

Если у вас возникли проблемы с входом в аккаунт, не стесняйтесь обратиться в нашу службу поддержки. Опытные сотрудники помогут вам быстро.

Будьте готовы к незабываемому игровому опыту в казино GG.BET. Мы ценим вас, как наших игроков, и стараемся предложить вам только лучшее азартное развлечение.

Успехов и приятного времяпрепровождения!

Моя страница в GG.BET

В свете растущей популярности онлайн казино, пользователи все чаще заходят на свои личные страницы и аккаунты для развлечения и игры. Рассмотрим функциональность GG.BET - онлайн казино, обсудим особенности личного кабинета и опишем возможности, доступные пользователям на их страницах.

Вход в личный кабинет GG.BET

Войти в GG.BET моя страница (личный кабинет) на сайте просто. Пользователю необходимо зайти на сайт GG.BET, найти кнопку "Вход в личный кабинет" и ввести свои данные - логин и пароль, которые пользователь выбирал при регистрации в казино. Кроме того, пользователи могут авторизоваться через социальные сети.

Особенности личного кабинета GG.BET

Моя страница GG.BET - это личный кабинет, интерактивное пространство, где пользователь может найти всю необходимую информацию о казино, своих играх, бонусах, участии в турнирах и других опциях. Кроме того, пользователь может проверить свой баланс, пополнить счет, вывести выигрыш, изменить данные своего профиля и просмотреть историю своих игр.

Игры, доступные в личном кабинете

Пользователь GG.BET имеет доступ к большому выбору игр, которые можно играть прямо на странице личного кабинета. Среди них - популярные слоты, карточные игры, рулетка, блэкджек, видео покер и другие развлечения. Нажатие на любую интересующую игру перенаправляет игрока на соответствующую страницу казино, где он может продолжить игру.

Бонусы и акции

Казино GG.BET предлагает своим пользователям различные бонусы и акции. Пользователь может узнать о текущих бонусах и акциях в своем личном кабинете и принять участие в них, если это соответствует его интересам. Кроме того, на странице казино есть специальный раздел "Бонусы и акции", где пользователи могут найти более подробную информацию о каждом предложении.

Участие в турнирах

Одним из наиболее интересных способов провести время в казино является участие в турнирах. Пользователь может выбрать любой турнир, который ему подходит по тематике или по размеру призового фонда, и принять участие в нем. Результаты турниров попадают на страницу личного кабинета пользователя, где он может следить за своей позицией и результатами других участников турнира.

Как залогиниться в казино GG.BET

В современном цифровом мире важно иметь простой и безопасный способ доступа к своему аккаунту. Именно поэтому GG.BET предлагает удобный механизм логина, который обеспечивает надежность и легкость входа.

GG.BET логин обеспечивает универсальность и доступность аккаунта с любого устройства, будь то компьютер, планшет или смартфон. Вам не нужно запоминать сложные пароли или хранить их в небезопасных местах. Просто введите свои учетные данные, и вы сразу попадете в мир азарта и развлечений.

-

Безопасность является главным приоритетом для GG.BET. Мы уделяем огромное внимание защите данных наших пользователей. При использовании логина GG.BET, ваши личные данные будут защищены надежной системой шифрования, гарантирующей конфиденциальность и предотвращение несанкционированного доступа к вашему аккаунту.

-

Простота использования. GG.BET логин разработан с учетом максимальной простоты и удобства. Вам не потребуется тратить много времени и усилий на настройку или вход в систему. Процесс логина является легким и осуществляется всего в несколько кликов. Это особенно удобно, если вы находитесь в движении и хотите получить быстрый доступ к своему аккаунту в любое время и в любом месте.

-

Дополнительные возможности. Помимо основной функции входа в аккаунт, GG.BET логин предлагает и другие полезные возможности. Например, вы можете использовать его для восстановления пароля в случае утери. Также, с помощью GG.BET логина вы можете получить доступ к различным акциям, бонусам и специальным предложениям, предоставляемым GG.BET.

Не тратьте время на сложные процедуры входа, выберите GG.BET логин и наслаждайтесь беззаботным и захватывающим миром онлайн-развлечений и ставок прямо сейчас!